香港奇点财经4月15日报道。4月12日,由埃隆·马斯克创立的xAI推出了一个新的人工智能模型——Grok-1.5V。这个模型是一个多模态人工智能模型,能够处理文本以及视觉信息,包括文档、图表、屏幕截图和照片。

Grok-1.5V的前身,Grok,自2023年11月发布以来,主要服务于X Premium Plus账户的订阅者。马斯克还透露,特斯拉计划在其车辆中集成Grok的轻量级本机版本,以提升用户体验。

Grok的设计灵感源自于科幻作品《银河系漫游指南》,其目标是回答所有问题。软件提供“有趣”和“常规”两种模式,其中“有趣”模式更具叛逆性和幽默感,为用户提供更加个性化的交互体验。

目前Grok-1.5V尚未公开发布,xAI称将很快向早期测试者和现有Grok用户推出。在官方公告中,xAI展示了Grok-1.5V的多样应用场景。

首先,Grok可以解决专业领域的问题,用户可以向它展示一张流程图照片,并要求Grok将其翻译成Python代码;又或是提出一个问题,要求Grok编写Python代码来解决它。在日常生活中,Grok的应用同样广泛而实用。用户仅需上传食品的配料表,Grok便能迅速计算出其卡路里含量。又或是将出现破洞的甲板拍照上传,获取是否需要更换的建议。另外,Grok还具有“想像”的功能。用户可以上传儿童的简笔画,并要求Grok根据它写一个睡前故事。对于网络上的流行文化或热门梗,Grok也能提供详尽的解释。

除了推出Grok-1.5V之外,该公司还发布了名为RealWorldQA的基准数据集。这一基准测试打造了一系列模拟真实生活场景的案例,尽管这些案例对人类而言可能轻而易举,如比较家居用品的尺寸、解读交通标志或判断停车空间等,但对于人工智能模型而言,它们却构成了巨大的挑战。

xAI希望通过这些贴近实际问题的测试,推动模型在现实世界应用中的精确度和实用性的提高。xAI表示,在使用RealWorldQA进行的对比测试中,Grok-1.5V超越了OpenAI的GPT-4V和Google Gemini Pro 1.5。

Grok-1.5V的推出,标志着xAI在实现其使命的道路上迈出了坚实的一步。然而,马斯克对于AI技术的发展始终抱有审慎的态度,强调其应以服务人类社会为最终目标。2023年7月,马斯克正式宣布了人工智能公司xAI的创立,同年12月,该公司正式在内华达州注册,马斯克明确表示,xAI为非盈利性质的企业。

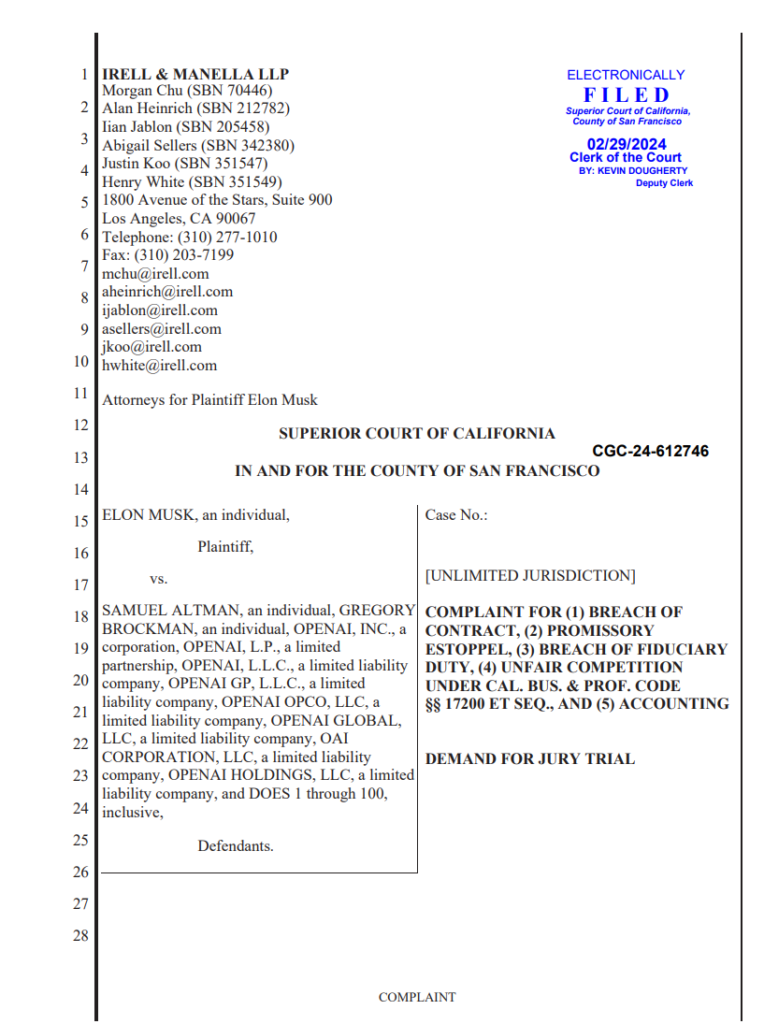

马斯克一直对AI可能给人类文明带来的风险保持高度警惕。xAI的网站主页上鲜明地标注着公司的使命:“增进人类对宇宙的理解”。最近,马斯克更是直言不讳地表示,在没有掌握至少四分之一的投票控制权的情况下,特斯拉在人工智能和机器人技术领域的研发让他感到不安。而在一个月前(2月29日),马斯克对OpenAI及其首席执行官奥特曼等人提起了诉讼,他指责奥特曼背离了初衷,将原本应该造福人类的技术变成了个人牟利的工具。